“Neuroderechos” y Por Qué los Necesitas

Artículo original y traducción de Elena Blanco-Suárez, Ph.D.

La mayoría de nosotros, especialmente a quienes nos interesa la tecnología, encontramos fascinante la manera en la que la Inteligencia Artificial (IA) y las neurotecnologías están evolucionando. Las usamos muchas veces a diario sin casi ni darnos cuenta. Por ejemplo, las predicciones de Google para planear cómo llegar al trabajo de la manera más rápida, evitando así estar atascada en tráfico y enfadándome con todo ser humano que me rodea, es IA. Y apuesto a que alguna vez has usado los servicios de transporte para compartir vehículo. Pues adivina, esas apps también son IA. Lo mismo que los filtros de spam, o la aplicación para depositar cheques online, por poner algunos ejemplos de lo que la IA está haciendo por ti. IA también hace que el contenido online sea más accesible para personas con discapacidades, por ejemplo con alt-text HTML para gente con problemas de vista, o a través de otras apps que permiten el lenguaje para aquellos que sufren secuelas de infartos cerebrales o problemas derivados de la enfermedad de Parkinson.

Por otro lado, las neurotecnologías tienen como objetivo manipular el cerebro y la mente a través de avances tecnológicos. El auge y desarrollo de las neurotecnologías ha sido increíble. Un ejemplo de neurotecnología es la Estimulación Cerebral Profunda (DBS en sus siglas en ingles), una técnica que consiste en la implantación de electrodos en el cerebro. Se usa normalmente para tratar epilepsia o Parkinson en pacientes que no responden a la medicación. Los beneficios de la DBS pueden cambiarle la vida al paciente. Debido a las posibilidades que este tipo de tecnologías ofrecen, muchas compañías han empezado a invertir más recursos en desarrollarlas y comercializarlas.

Parece que la IA y las neurotecnologías han revolucionado el mundo para mejor. ¿Pero es realmente así?

¿Qué son los Neuroderechos?

Rafael Yuste, profesor del NeuroTechnology Center de la Universidad de Columbia en New York, y miembro de la BRAIN Initiative, se dio cuenta de que a medida de que la IA y su relación con las neurotecnologías iban avanzando también lo hacía la preocupación sobre las posibles implicaciones éticas. Sin embargo, nadie estaba haciendo nada por controlarlo. Junto a Sara Goering, profesora de la Washington University, y un grupo de científicos también preocupados, se dieron cuenta de que la IA y las neurotecnologías estaban íntimamente conectadas, y que no había ningún tipo de regulación ética de cómo se podían aplicar conjuntamente. Regular cada caso individual no resultaba práctico, y por lo tanto comenzaron a redactar los fundamentos éticos que regularían el uso y desarrollo de la neurotecnología: lo que ahora llamamos “neuroderechos”.

Los cinco principios éticos en los cuales se basan los neuroderechos son:

Privacidad y Consentimiento. Es posible adquirir una gran cantidad de datos de los usuarios de las neurotecnologías (¿sabías que la forma en la que usas tu Smartphone se puede utilizar en investigaciones de comportamiento?), y esos datos deben de protegerse. Cada individuo debería ser capaz de decidir no compartir sus datos con terceras partes sin su consentimiento, y así evitar situaciones tan peliagudas como las que hemos visto en el pasado con otras formas de IA, como en el escándalo de Facebook y Cambridge Analytica.

Identidad. Representa nuestra habilidad para pensar y sentir por nosotros mismos, independientemente de cualquier neurotecnología aplicada. Por ejemplo, algunos pacientes tratados con DBS han informado sentir depresión, tendencias suicidas, ansiedad, hiperreactividad emocional e hipomanía. A pesar de que estos síntomas no aparecen en todos los pacientes tratados con DBS, son suficientemente preocupantes como para preguntarnos: ¿son los electrodos implantados los responsables por estos cambios en la personalidad?

Libre Albedrio. Los pacientes generalmente reciben información sobre los posibles efectos secundarios y riesgos asociados a implantar electrodos en el cerebro. Sin embargo, muchas de estas respuestas emocionales adversas no se encuentran en la lista de efectos adversos que los pacientes ven cuando dan su consentimiento. ¿Quién tiene la culpa si el paciente experimenta algún problema con su libre albedrio o emociones adversas? ¿Sabrán si quiera que es debido al DBS? ¿Quién será responsable de cualquier resultado desastroso que se derive? El establecimiento de neuroderechos tiene como objetivo el proteger el libre albedrio de los pacientes a través del desarrollo responsable de las neurotecnologías.

Aumentación. Algunas neurotecnologías están desarrollándose con el objetivo de mejorar las capacidades cognitivas. Llamémoslo “doping cognitivo”. Es necesario establecer qué “neurotecnologías de mejora” pueden usarse y cómo usarlas apropiadamente, para así prevenir posibles inequidades entre los que deciden y pueden utilizarlas y los que no.

Prejuicios. Las neurotecnologías son desarrolladas por los humanos, y los humanos tenemos prejuicios. Es necesario asegurarse que dichas neurotecnologías estén libres de prejuicios. Por ejemplo, imagínate preguntarle a Google qué regalo sería el más adecuado para tu madre el día de su cumpleaños, y lo único que Google te sugiere son productos de limpieza. Nos damos cuenta de que eso es altamente problemático, y hace falta que las neurotecnologías también sean capaces de “darse cuenta”. Recientemente se ha acusado a cierta tecnología de reconocimiento facial de tener prejuicios racistas. Los neuroderechos pretenden prevenir este tipo de situaciones con la neurotecnología.

¿Por qué necesitamos Neuroderechos?

Con el crecimiento de negocios construidos alrededor de interfaces cerebro-maquina, tales como los esfuerzos de Elon Musk, muy en el estilo de Black Mirror, por desarrollar una tecnología que supuestamente sea capaz de leer la mente, parece necesario que las leyes y los Derechos Humanos por una vez se adelanten a la tecnología. Necesitamos poder prever todos los desastres potenciales que la IA y las neurotecnologías sin regular pueden traernos.

El Dr. Rafael Yuste lo dice alto y claro: “Esto es un tema urgente. No es ciencia ficción, y necesitamos regulación urgentemente. Hay muchas cosas que se están haciendo y no sabemos, y otras que sabemos y son muy preocupantes. Si no hacemos nada, acabaremos en la típica situación en la que es demasiado tarde para intentar solucionar nada. Muchas compañías están diseñando prototipos que pueden leer las señales cerebrales para controlar equipos robóticos y codificar intenciones y pensamientos para aplicarlos a la tecnología de control”.

Por ejemplo, ya hace dos años que Facebook puso un equipo a trabajar en el desarrollo de la tecnología thought-to-type(literalmente, “de pensamiento a tecleo”). Aunque aseguran que su intención no es “leer la menta de los usuarios”, eso es exactamente en lo que llevan trabajando y progresando desde 2017. Es por eso que el Dr. Yuste urge a los gobiernos a “mantenerse a la par que el progreso científico y tecnológico, y estar preparados para responder”.

¿Qué Podemos Hacer Nosotros?

Hoy por hoy, el gobierno chileno ha estado trabajando con Yuste para modificar su constitución e incluir los Neuroderechos. Para noviembre de 2019, la Constitución de Chile será la primera en el mundo y en la historia en abordar de forma específica la regulación de neurotecnologías para proteger a sus ciudadanos. Cosas como el proyecto de Facebook thought-to-type serán ilegales en Chile.

“La integridad física y psíquica permite a las personas gozar plenamente de su identidad individual, y del derecho a actuar de manera autodeterminada, ninguna autoridad o individuo podrá, por sí o por medio algún mecanismo tecnológico, aumentar, disminuir o perturbar dicha integridad individual. Sólo la ley podrá establecer los requisitos para limitar este derecho, y los requisitos que debe cumplir el consentimiento en estos casos.”

Cláusula 19 de la Constitución chilena

Es difícil convencer a las autoridades y a la sociedad de los peligros de la neurotecnología, ya que muchos creen que es pura ciencia ficción. En Chile, el apoyo de la sociedad fue clave para convencer al gobierno de la necesidad e importancia de los neuroderechos. Yuste nos cuenta que como ciudadanos podemos abogar por los neuroderechos y presionar a los gobiernos para que impulsen leyes que nos protejan.

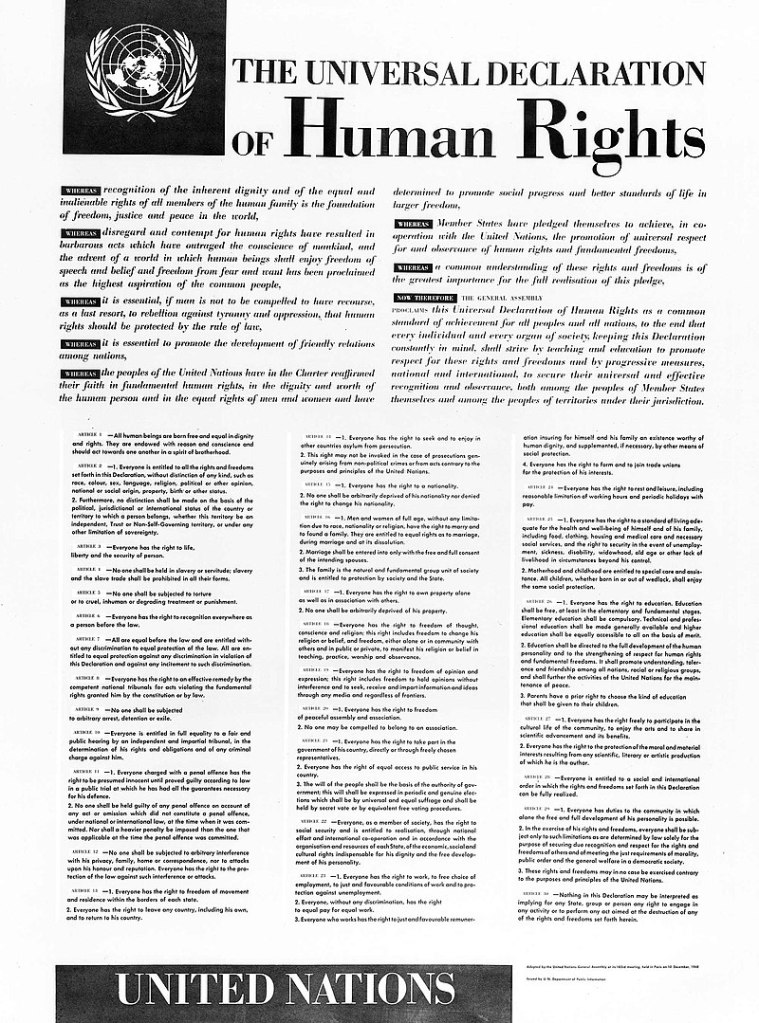

El gol de Dr. Yuste es llegar a incluir los neuroderechos en la Declaración de los Derechos Humanos para así establecer una clara guía que nos proteja de las neurotecnologías y como pueden llegar a impactar nuestras habilidades, identidad individual (nuestra integridad mental y física) y agencia (nuestra habilidad para elegir nuestras propias acciones), y por ultimo nuestras vidas. Además, Yuste está liderando la creación de la Iniciativa por los Neuroderechos (Neurorights Initiative en inglés) en el NeuroTechnology Center que se dedicara enteramente al logro de estas metas.

De todas maneras, no parece que estemos totalmente condenados. Como Rafael Yuste dijo durante su discurso durante la Asamblea de la Union Inter-Parlamentaria en Catar, “a pesar de que haya podido sonar como una visión pesimista, creo que la doble revolución en Neurotecnología e IA pueden ser un nuevo Renacimiento, ya que el llegar a entender el cerebro nos ayudara a comprender quienes somos realmente, […] y esto podría llevar a un nuevo humanismo. Habrá importantes implicaciones con resultados positivos en educación, ciencia, medicina, legislación, economía, la sociedad y en las relaciones internacionales ya que la raíz de todo conflicto suele deberse la falta de comprensión entre nosotros”.

La autora quiere agradecer al Profesor Rafael Yuste por cederle su tiempo para hablar sobre los neuroderechos y todos sus proyectos en defensa de los mismos.

Referencias

- Yuste R., Goering S. (2016) On the Necessity of Ethical Guidelines for Novel Neurotechnologies. Cell.

- Yuste R., et al. (2017) Four ethical priorities for neurotechnologies and AI. Nature.

- Harari, G. M., Lane, N. D., Wang, R., Crosier, B. S., Campbell, A. T., & Gosling, S. D. (2016). Using Smartphones to Collect Behavioral Data in Psychological Science: Opportunities, Practical Considerations, and Challenges. Perspectives on psychological science : a journal of the Association for Psychological Science, 11(6), 838–854.

- Klaming, L. & Haselager, P. Neuroethics (2013) Did My Brain Implant Make Me Do It? Questions Raised by DBS Regarding Psychological Continuity, Responsibility for Action and Mental Competence. Neuroethics 6: 527.

You must be logged in to post a comment.